Partager la publication "Voici comment échapper à la reconnaissance faciale sur les réseaux sociaux"

En janvier 2020, le New York Times révélait au grand public l’existence de Clearview AI, un outil de reconnaissance faciale capable de délivrer l’identité d’une personne à partir d’un jeu de plus de 3 milliards de photos récupérées sur les réseaux sociaux… Sans l’accord de leurs propriétaires.

Les créateurs de Clearview n’hésitent pas à présenter leur logiciel comme une sorte de chevalier blanc numérique, destiné aux services de police américains. “La technologie de Clearview AI a aidé les forces de l’ordre à traquer des centaines de criminels en cavale, parmi lesquels des pédophiles, des terroristes et des trafiquants sexuels”, se félicitent-ils sur leur site internet.

À lire aussi : Clearview, l’appli de reconnaissance faciale qui menace notre vie privée

Mais cet argument sécuritaire n’a pas su contenir la vague de protestations qui suivi les révélations du New York Times. Notamment parce que les services de police ne sont pas les seuls à avoir accès à l’application : selon une enquête de BuzzFeed, la liste des utilisateurs de Clearview comprendrait plus de 2 200 organisations publiques ou privées. Des clients installés dans plus de 27 états, dont la France, et plusieurs pays où les droits de l’Homme ne sont pas garantis.

En bref, il est impossible de savoir jusqu’où peut aller Clearview, ni même s’il s’agit du seul logiciel de ce type actuellement en activité. Assistons-nous à la naissance d’un Big Brother ? Peut-être. La bonne nouvelle, c’est que vous pouvez contribuer à le ralentir en utilisant l’un des deux logiciels présentés ci-dessous.

Fawkes, le logiciel qui empoisonne Clearview à la source

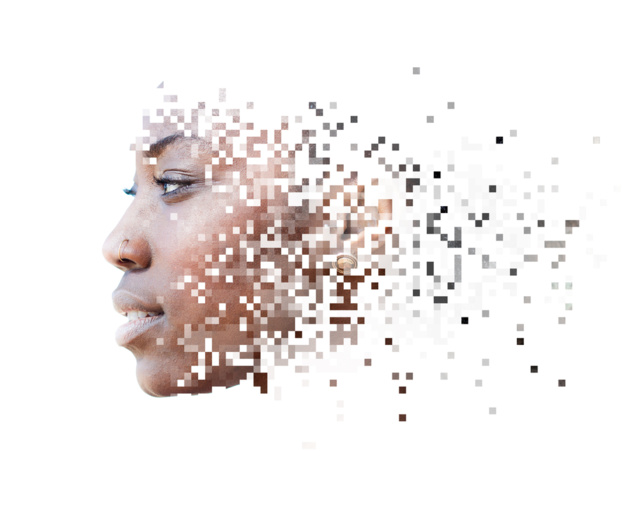

Un logiciel comme Clearview ne vous identifie pas grâce à la couleur de vos yeux, de vos cheveux ou de votre peau, mais grâce à une certaine distribution de pixels, très spécifique. L’outil Fawkes, développé par des chercheurs et étudiants de l’Université de Chicago, vous permet de modifier ces pixels. Pour l’œil humain, le changement est imperceptible. L’algorithme, en revanche, verra une tout autre personne.

Pour preuve, les créateurs de Fawkes l’ont opposé aux IA de reconnaissance faciale de Microsoft (Azure Face), d’Amazon (Rekognition), et du géant de la tech chinoise Megvii (Face++). Face à ces logiciels, parmi les plus performants en la matière, le taux de succès de Fawkes oscillait entre 95 et 100 %. Et il a été perfectionné depuis.

L’outil de l’Université de Chicago dispose d’un plan à long-terme : celui “d’empoisonner” Clearview et ses semblables. “Nous utilisons les photos protégées comme un cheval de Troie”, a détaillé Ben Zhao, enseignant chercheur ayant participé au développé de Fawkes, au média américain The Verge. Les outils comme Clearview ont besoin de s’alimenter en nouvelles photographies pour s’améliorer : en intégrant sans le savoir des photos “corrompues” par Fawkes, leurs algorithmes devraient devenir de moins en moins performants.

Mais son apparition n’a pas vraiment ébranlé les créateurs de Clearview. Le PDG de l’entreprise, Hoan Ton-That, a déclaré ceci au New York Times : “Il y a des milliards de photos non truquées sur internet, toutes sous des noms de domaine différents. En pratique, il est presque certainement trop tard pour perfectionner une technologie comme Fawkes et la déployer à large échelle.”

C’est en partie vrai. Si nos photos non modifiées ont peut-être déjà été aspirées par des algorithmes tels que Clearview, les remplacer progressivement par des clichés truqués pourrait changer la donne. Les nouveaux utilisateurs d’Internet, quant à eux, peuvent encore bénéficier du plein potentiel de Fawkes.

Encore faut-il que cet outil soit utilisé par un maximum de personnes. Gratuitement mis à disposition du grand public par l’Université de Chicago, il comptabilisait plus de 100 000 téléchargements le 3 août. Mais le logiciel n’existe que sur Mac et Windows et aucune version mobile ou web n’est prévue. Par souci de sécurité, les créateurs de Fawkes ont privilégié un logiciel hébergé localement sur votre ordinateur.

Camera Adversaria, l’outil de résistance qui tient dans votre poche

Les utilisateurs de smartphones peuvent toujours tester Camera Adversaria, l’application développée à l’Université de Canberra, en Australie et disponible gratuitement sur Google Play Store. Un outil capable, si vous le souhaitez, de remplacer l’application photo de votre téléphone. Son algorithme appliquera alors sur les visages photographiés une distorsion dont vous pourrez choisir l’intensité, dont dépendra le niveau de protection de vos images.

Contrairement à Fawkes, l’objectif de Camera Adversaria est de rendre votre visage tout bonnement indétectable par les algorithmes, et non plus que ces derniers le confondent avec un autre. Avec un léger désagrément : une protection élevée ajoute un certain “grain” à la photographie.

À lire aussi : La mode peut-elle nous protéger de la reconnaissance faciale ?

“Je peux dire avec une certaine confiance que les distorsions les plus importantes peuvent tromper tous les outils de reconnaissance faciale utilisés à l’heure actuelle”, a assuré son créateur, Kieran Browne, dans un entretien pour l’Association for Computing Machinery. Il ne précise pas, en revanche, contre quels logiciels son application a été testée. “Bien sûr, ajoute-t-il, rien ne garantit que ce sera suffisant pour contrer la prochaine génération d’algorithmes. C’est, malheureusement, une sorte de jeu du chat et de la souris.”

D’autant que personne ne sait combien de ces outils sont en cours de développement. L’équipe à l’origine de Fawkes n’avait pas attendu les révélations du New York Times concernant Clearview pour développer son algorithme. Leur site internet donne le ton : “Nous pensons, y écrivent-ils, que Clearview AI n’est que la partie émergée de l’iceberg”.