Partager la publication "ChatGPT sur la voix de l’intelligence artificielle"

Le 25 septembre 2023, OpenAI a annoncé le lancement du mode vocal pour ChatGPT, permettant aux utilisateurs de converser oralement avec l’assistant virtuel. Cette fonctionnalité, initialement réservée aux abonnés payants ChatGPT Plus et Enterprise, a été progressivement déployée sur ordinateur mais aussi sur iOS et Android. Une nouvelle version avancée de cette fonction devrait être disponible pour tous cet automne, promettant une interaction plus naturelle et émotionnelle avec l’intelligence artificielle. Cette “voix intelligente” pourrait même être capable de “comprendre et répondre avec des émotions et des signaux non verbaux”, avance OpenAI.

Cette fonctionnalité, annoncée lors du lancement de ChatGPT 4o mais qui ne sera pas déployée avant la rentrée, vise à transformer le chatbot en un véritable assistant intelligent capable de communiquer de manière plus fluide et dynamique. Le but est de permettre aux utilisateurs de discuter avec l’IA de façon plus naturelle, se rapprochant ainsi d’une réelle conversation humaine et pas de commandes données à un assistant vocal comme Siri, Google ou Alexa.

Des défis techniques et éthiques à relever pour que ChatGPT donne de la voix

Le développement de ce mode vocal avancé fait face à plusieurs défis techniques. OpenAI travaille à améliorer la qualité de la synthèse vocale, la compréhension des émotions et la capacité à réagir de manière appropriée aux signaux non verbaux. L’entreprise doit également s’assurer que l’assistant vocal puisse gérer des conversations complexes tout en maintenant une réactivité optimale.

Un vrai challenge qui a obligé la firme américaine à annoncer sur X qu’elle devait repousser le lancement du nouveau service, le temps de régler quelques problèmes techniques. Il s’en est expliqué sur X (Twitter) le 25 juin : “Nous avions prévu de commencer à le déployer en version alpha auprès d’un petit groupe d’utilisateurs de ChatGPT Plus fin juin, mais nous avons besoin d’un mois de plus […]. Par exemple, nous améliorons la capacité du modèle à détecter et refuser certains contenus. Nous travaillons également à améliorer l’expérience utilisateur et à préparer notre infrastructure pour qu’elle puisse servir des millions de personnes tout en maintenant des réponses en temps réel.”

Des considérations éthiques entrent notamment en jeu. La capacité de l’IA à imiter des voix humaines et à exprimer des émotions soulève également des questions sur les limites à imposer à cette technologie pour prévenir d’éventuels abus.

Des applications multiples et un potentiel immense

Le mode vocal de ChatGPT ouvre la voie à de nombreuses applications pratiques. Il peut être utilisé pour l’apprentissage des langues, l’assistance aux personnes malvoyantes, ou encore comme compagnon de conversation pour les personnes isolées. Dans le domaine professionnel, il pourrait révolutionner le service client, offrant une assistance vocale 24/7 capable de comprendre et de répondre à des requêtes complexes.

Cependant, cette avancée soulève également des questions éthiques. La capacité de ChatGPT à imiter la voix humaine de manière si convaincante pourrait être utilisée à des fins malveillantes, comme la création de deepfakes audio. OpenAI a déclaré travailler sur des mesures de sécurité pour prévenir ces abus potentiels mais, pour l’heure, il semble impossible de pouvoir identifier à coup sûr ce nouveau genre d’arnaque reposant sur la voix. Particuliers comme entreprises sont visés par le détournement de cette technologie.

Gare aux escroqueries par clonage vocal

Les escroqueries de clonage vocal par IA existent déjà. Un couple américain a ainsi été rançonné après que des faussaires ont utilisé l’intelligence artificielle pour cloner la voix de leurs proches. En pleine nuit, croyant avoir affaire à sa belle-mère paniquée au téléphone, une femme a passé le téléphone à son mari qui après avoir brièvement eu sa “mère” au téléphone a ensuite échangé avec le soi-disant homme qui l’avait enlevée.

Ce dernier demandait le versement immédiat d’une importante somme d’argent. La voix de la belle-mère ayant été parfaitement clonée, le couple est tombé dans le panneau et a procédé au paiement… avant de s’apercevoir que la belle-mère en question était tranquillement endormie chez elle. À Hong-Kong en février dernier, un employé d’une firme a procédé au virement de 25 millions de dollars après une soit-disant visioconférence avec des collègues dont le visage et la voix avaient été clonés… La solution ? Difficile à trouver à l’heure actuelle. Se mettre d’accord avec ses proches pour utiliser un mot ou une phrase d’authentification en cas d’urgence peut être un début…

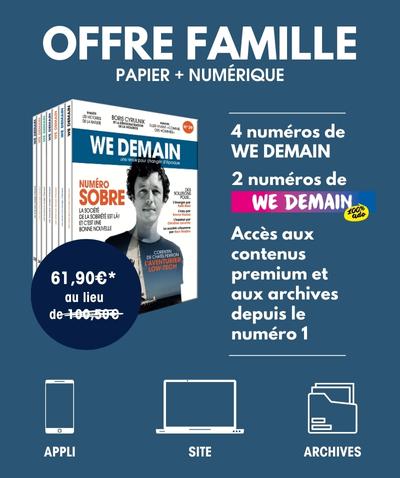

SOUTENEZ WE DEMAIN, SOUTENEZ UNE RÉDACTION INDÉPENDANTE

Inscrivez-vous à notre newsletter hebdomadaire

et abonnez-vous à notre magazine.